计算机系优秀毕设题目_新颖的题目

1 立题依据

1.1 目的与意义

在中国互联网以及移动通信网络的不断发展之下,智能手机也得到了更为普遍使用。各大证券商、软件应用开发商、网络运营商以及手机的各大操作系统商为了赢得广泛的市场,获取更大的利润,给用户提供了更多的应用程序。其中手机炒股类 APP作为一种新兴的移动互联网应用也在不断改变着人们炒股的形式与过去的柜台直接交易、电话委托、短信、PC机和手机wap炒股等,手机APP炒股能够利用手机终端通过无线技术将数据和信息服务进行传输,使得炒股变得不受时间和空间的限制。这种移动炒股方式便捷、同时不容易被发现,只要移动终端在网络覆盖的区域内(手机通信信号接入或 WIFI 的接入)股民们就能够进行行情的查看、股票的交易,借助移动通信网络或无线网络能够真正的实现随时、随身、随地进行证券投资,为股民们创造了崭新的投资体验[1]。在股票交易方面,依据和讯网所提供的数据,截止到2014年的12月,我国当前年活跃炒股人数在4750万人左右,其中近2000万的股民在使用移动终端进行炒股,占炒股总人数的42%。每月的交易用用有650万人,其中会采用移动终端进行交易的用户有230万,占到总交易的35%[2]。

随着手机炒股APP应用的快速发展,手机APP炒股也逐渐成为一般股民的看盘、交易的普遍选择。其中的最主要原因作者认为有下面两个方面。

第一个方面是基础设施的组建成熟。无线网络和移动智能终端的不断发展成熟,让一般的股民利用手机炒股APP的门槛降低。同时,4G无线移动通信以及移动互联网 WIFI 技术的发展成熟,无线网络已经是无处不在,覆盖了人们生活的每个角落。无线网络的发展极大的提高了人们的上网体验,增大了人们的上网环境,使接入网络的地点不再局限于特定的区域,而是向各个地方扩散,随时随地连接网络。同时智能手机的快速发展使手机的性能得到了显著的提升,相应的机器价格却在持续降低。第二个原因是股民手机炒股习惯的形成,为手机 APP 炒股应用提供了大量的潜在用户。由于证券交易市场的瞬息万变、波澜起伏,对于一般的上班族或者其他不能随时随地的了解股市行情并进行交易的股民来说,利用手机APP应用进行炒股,充分的弥补了传统炒股的时间性和地域性的问题。随着手机炒股APP软件的完全性的进一步完善,对于一般的股民来说利用手机炒股APP进行炒股已经成为了他们的第一选择。同时越来越多的证券公司、互联网公司也进一步加大了对手机炒股APP软件的开发并完善。

2 研究的主要内容及预期目标

2.1 研究主要内容

本设计主要研究“基于网络爬虫的炒股app的设计与实现”,包含对数据的爬取和云端数据库的搭建以及app可视化界面的设计。

2.2 预期目标

本设计是基于Python的Scrapy框架对数据进行爬取,预期目标如下:

(1)对目标网站进行侦测,看是否能对数据进行爬取。

(2)搭建云端数据库将爬取的数据存入数据库中

(3)设计app的界面。

(4)在手机端实现数据交互。

3 设计实现方案

3.1 系统总体设计

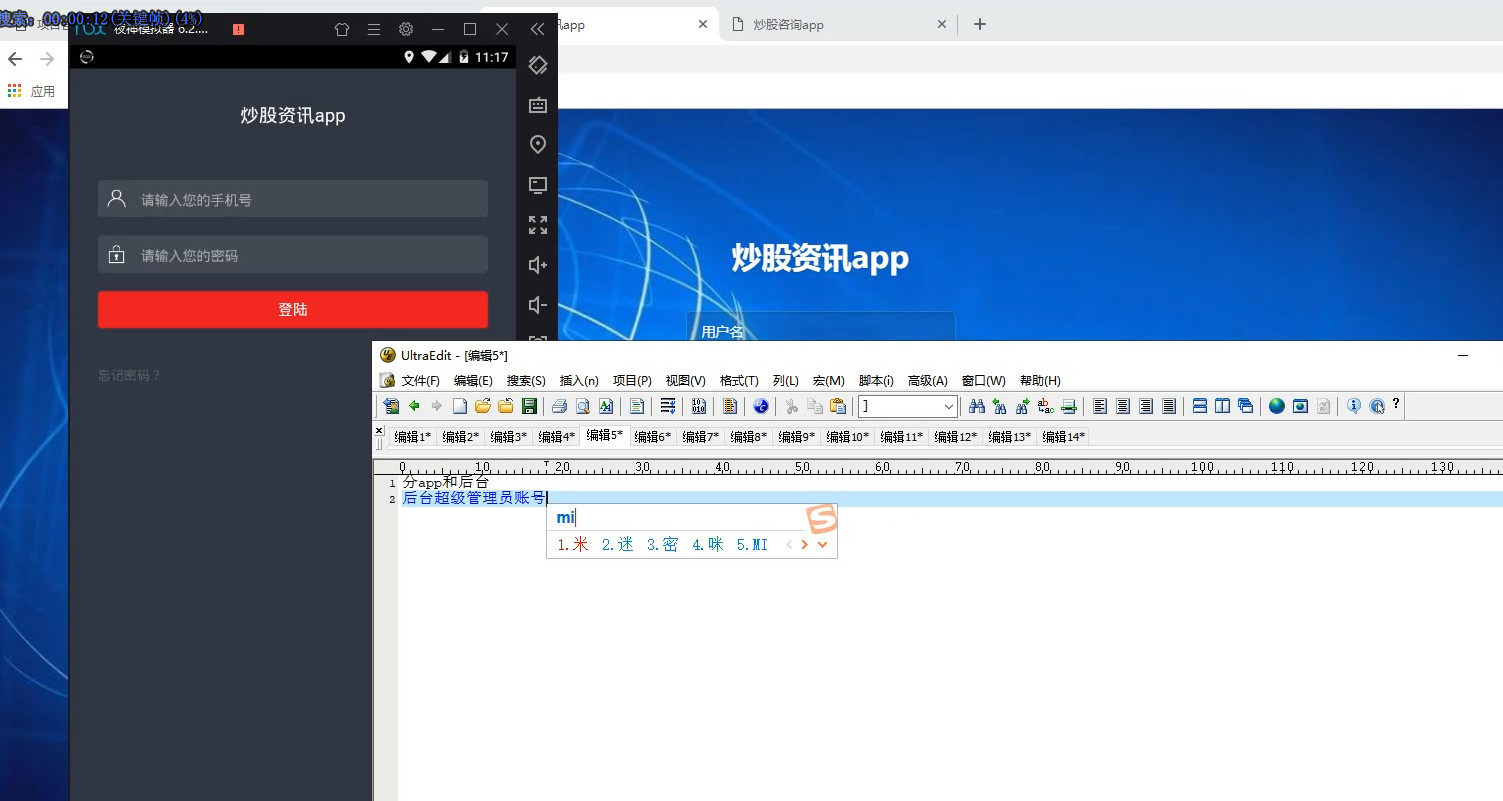

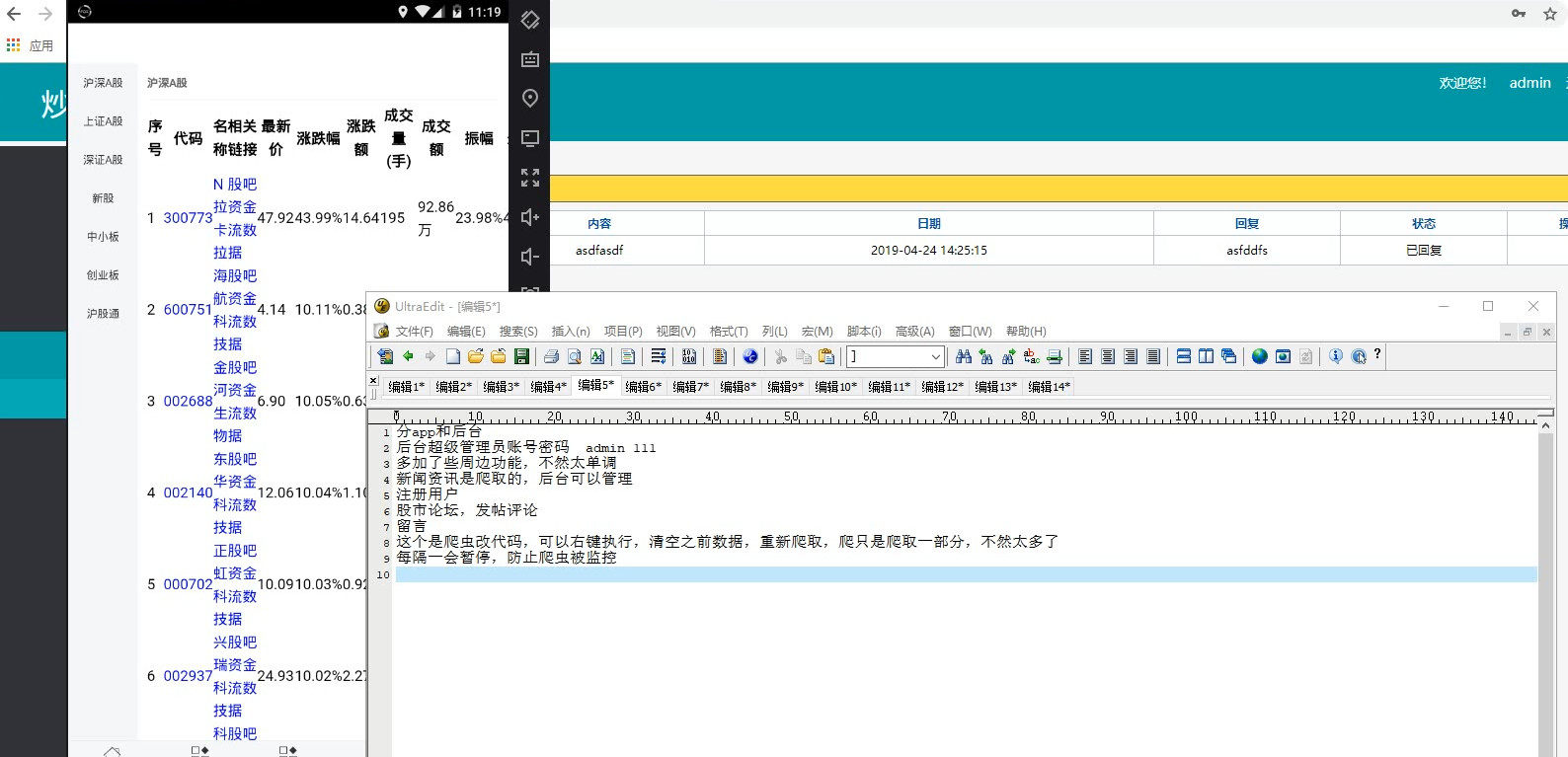

系统总体设计如图1所示。

图1 系统整体图

系统整体由数据库和App组成。App是面向用户的,负责将用户所需的信息直观的传达给用户。数据库是App的支撑,负责将爬取的数据进行处理。还有更多“基于android的毕业设计”观看下载,可以关注东哥毕设。

3.2 具体设计

3.2.1 网络爬虫

爬虫的主要目的是将互联网上的网页下载到本地形成一个互联网内容的镜像备份。爬虫的基本结构及工作流程图如图2所示。

图2 爬虫基本结构

不同网站的页面可能采用不同的编码方式,常用的编码方式有UTF-8编码,GBK编码以及ISO-8859-1编码。因此,在获得HTTP响应时,需要检测响应首部的“Content-Type”项,以获得网站制定的编码方式。按照指定编码下载的网页才不会出现中文乱码[3]。

爬虫从Web总下载页面,还受到Robots协议的约束。Robots协议的全称是“网络爬虫排除标准”(Robots Exclusion Protocol),网站通过Robots协议限定搜索引擎对网站内页面的抓取权限以保证网站数据的安全和独立。Robots协议可以屏蔽网站中比较大的文件,如:图片,音乐,视频等,节省服务器宽带,方便搜索引擎抓取网站内容。Robots协议还可以设置网站地图链接,引导爬虫抓取网站页面[4-6]。通过使用基于Python语言开发的Scrapy开源爬虫框架来进行爬虫开发,指出了Mongo DB为代表的No Sql数据库在元数据存储中的巨大作用。详细介绍了Scrapy开发爬虫的流程和实现细节。再次,讨论了对于爬虫设计领域的关键问题,本文实现的自定义爬虫的解决方法。采用了更换Cookie和user-agent欺骗来突破站点限制。而URL去重和多线程并发的问题,则采用并分析Scrapy自带的解决方案。若爬取的URL外链层次特别多,Python执行会耗费很长时间,如果结合Python的多线程技术,并考虑下载缓存优化和并发性,将会使性能得到改善